NVDA FY24Q2 法說會在聊甚麼?

雖然財報已經公布一陣子,但覺得法說會上有非常多重點值得記錄,尤其是好多很 hardcore 、很重要的技術,不僅僅是對未來的投資,甚至可能影響到工作與生活,就還是硬著頭皮盡力試著把他解釋清楚。

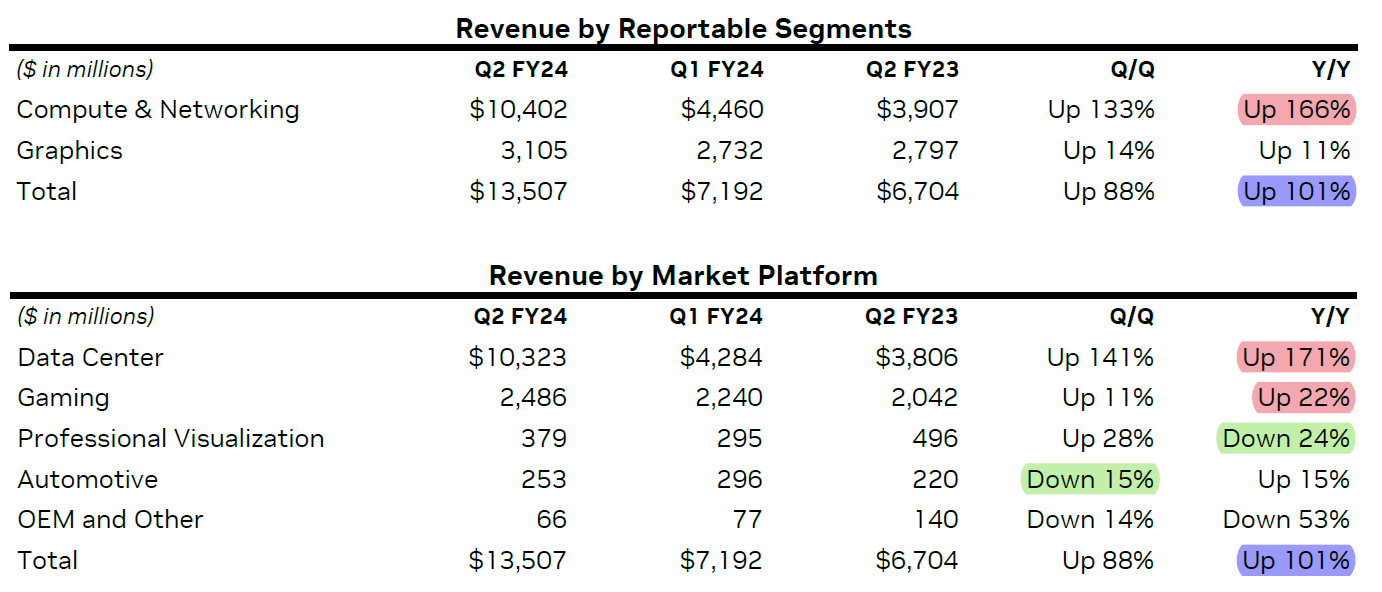

FY24Q2 季報

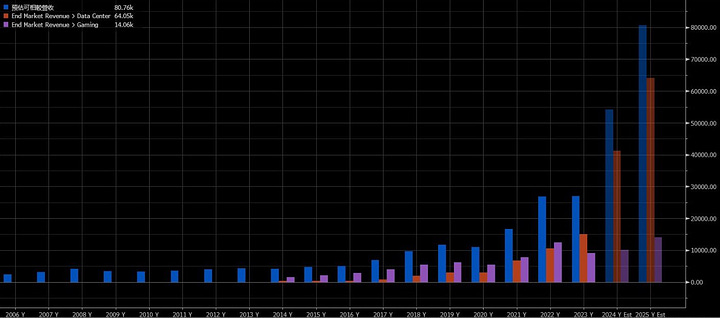

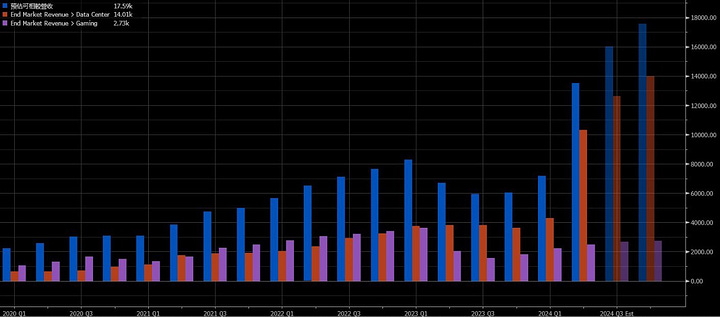

營收:年增 101%,季增 88% 達 135.1 億,預期 103 億

資料中心:年增 171%,達 103.2 億

遊戲:年增 22% 至 24.9億 (終於轉正成長)

調整毛利率:71.2%

EPS:2.70 美元,預期 1.91 美元

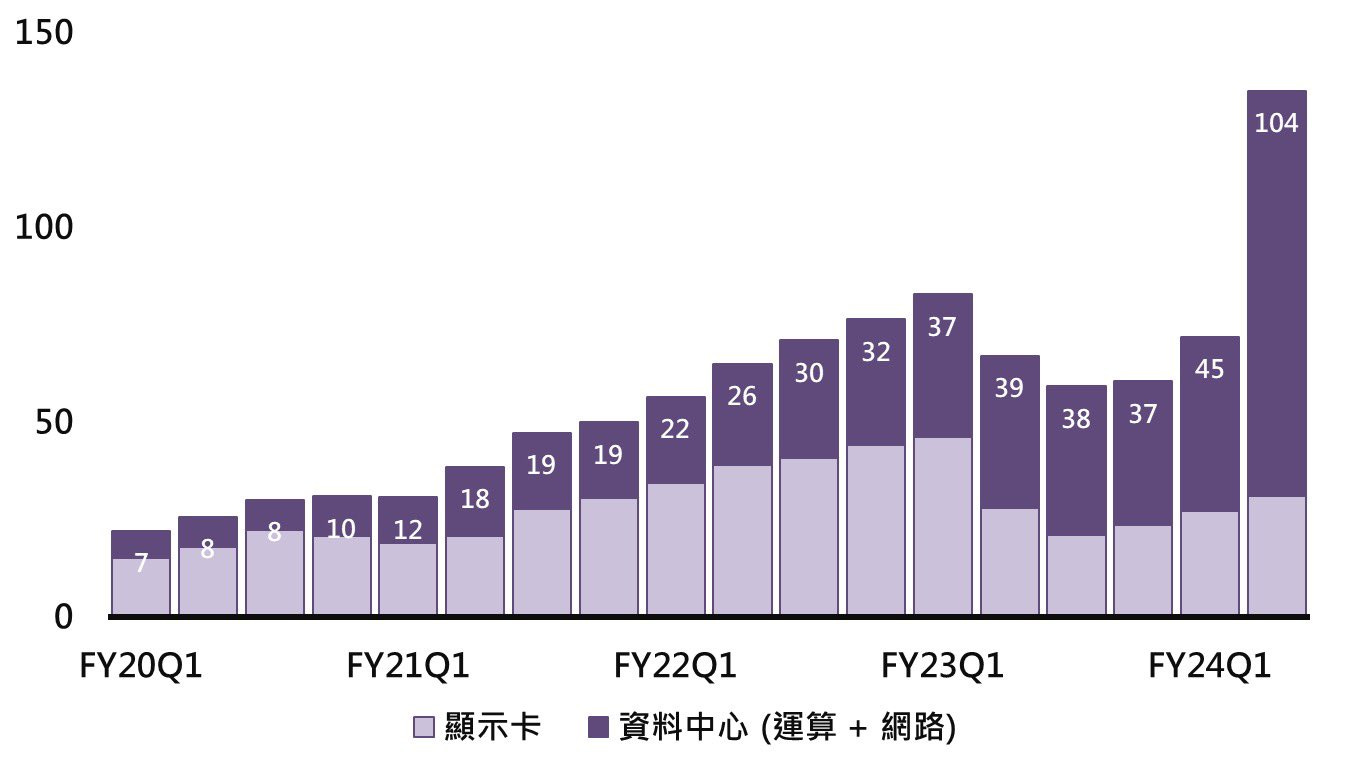

【看圖說故事】圖表只挑重點看。

受中國車市影響,Automotive 的營收持續季減;不過,營收比重第二大的 Gaming 則是呈現季增,有稍微回溫。

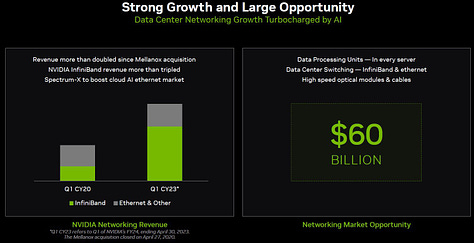

但最重要的是,資料中心的營收年增 171%,而運算與網路的營收也是年增 166%

總營收年增 101%至 135 億美元,毛利率達 70.1%,主要是因資料中心產品包含大量的軟體和高複雜度,獲利提升也讓 NVDA 滿手現金。

根據展望,目前訂單能見度已到明年底,未來幾季的產能將持續增加,而 L40S 將有效的紓緩一直不斷成長的需求,因此 FY24Q 可望再季增 18% 至 160 億美元,FY24Q2 毛利率將微增至 72.5%,EPS 將達 3.17 - 3.47 美元,高於市場預期的 2.29 美元;

成長都是來自於資料中心,又可分為運算與網路等兩項產品,接下來就來看看法說會上,有甚麼重點!

【看圖說故事】先前這篇文章用估值的角度來評估 NVDA 到底貴不貴,現在先來看看 BASM (商業模式、假設、策略與管理階層),最後用近期數字來重新評估,目前的估值到底合不合理?

黃仁勳的信心、野心與佈局:

NVDA 的優勢?

4 個特點與幹掉 NVDA 的八個步驟!

CSPs、大型消費網站與企業用戶,營收比重變化?

從訂單看到客戶的投入!

成長信心?

看見兩個趨勢!

確保客戶繼續買單?

買越多!省越多!時間就是金錢!

訓練跟推論?

人每天都在產生數據!推論比你想得更需要運算能力!

策略:

產品策略:

天下武功,唯快不破;再強的硬體,也沒辦法打贏團體戰!

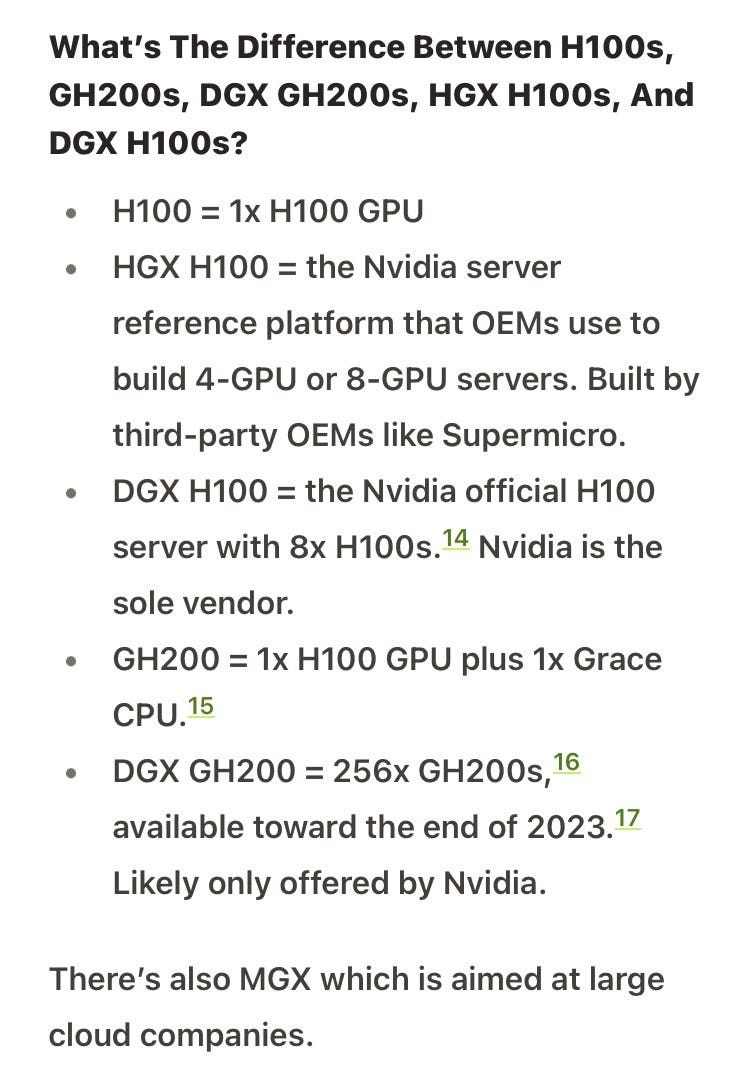

H100、L40S、CoWoS、SuperChip、SuperComputer、互連技術!

商業策略:

賺硬體也賺軟體、賺本地端也賺雲端!

投資新創可以甚麼都賺 !

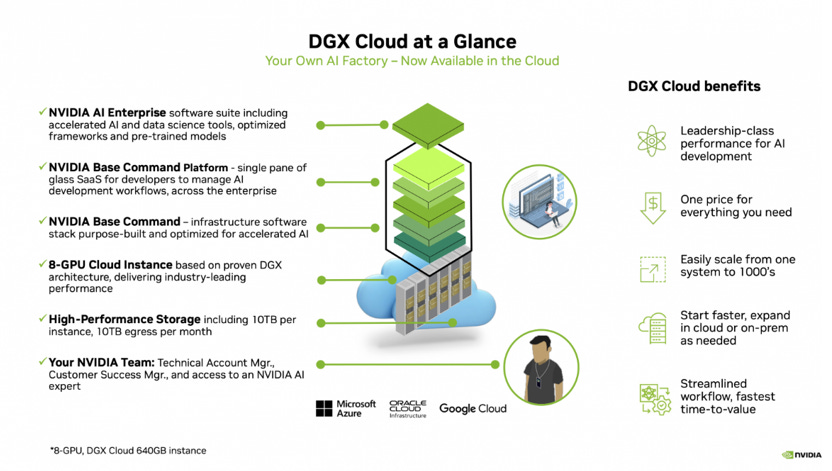

AI Foundation 與 AI Enterprise、DGX 雲端與 CSP、HGX 雲端與 OEM、投資 GPU 雲端新創!

講完硬體,講 CUDA 軟體:

從 2006 年開始、持續在蓋的護城河 - CUDA

進一步了解黃仁勳,可以看 Ben Thompson的 Strategecy:An Interview with Nvidia CEO Jensen Huang about Manufacturing Intelligence)

【看圖說故事】CUDA 的競爭力 - 天下武功,惟快不破;

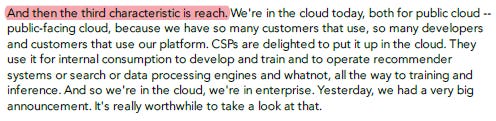

4 個特點:

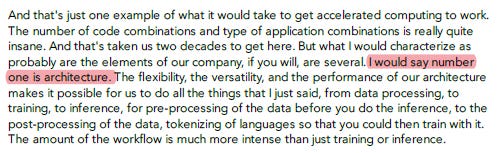

架構很靈活、通用,並且性能出色:因此能夠完成從資料處理、訓練、推論,到資料預處理和後處理和語言 token 化。

有大量的軟體開發人員使用 NVDA 的平台:因開發人員希望接觸最多使用者。

覆蓋度:在公有雲和企業環境中都有很高的市占率。

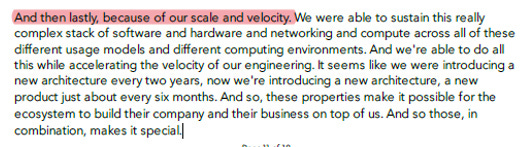

規模和速度:NVDA 能在所有不同使用模型和運算環境中,持續提供複雜的軟體、硬體、網路和運算堆疊。NVDA 在不斷加速其工程速度,每 6 個月就會推出新的架構和產品 (想像蘋果 1 年有 2 次新機發表會)。

如果有興趣看 NVDA 如何建構護城河的,可以看 The New York Times 的摘要,2006 年推出的 CUDA 實在是一個很重要的布局 (目前有 400 萬開發者);

最近其他的商業合作,如既投資新創、又與新創合作,以及推出自有雲端服務,還架在客戶/競爭對手的雲端上,看起來也是很厲害的布局。

【看圖說故事】四個特點的敘述其實有點籠統,雖可藉由法說會內容慢慢了解 NVDA 的佈局,但如果先從另一個角度來看,也許會更容易了解。:

先設計出跟 H100 一樣好的 GPU ( AMD 、 GOOGL 與 AMZN 正在努力) ;

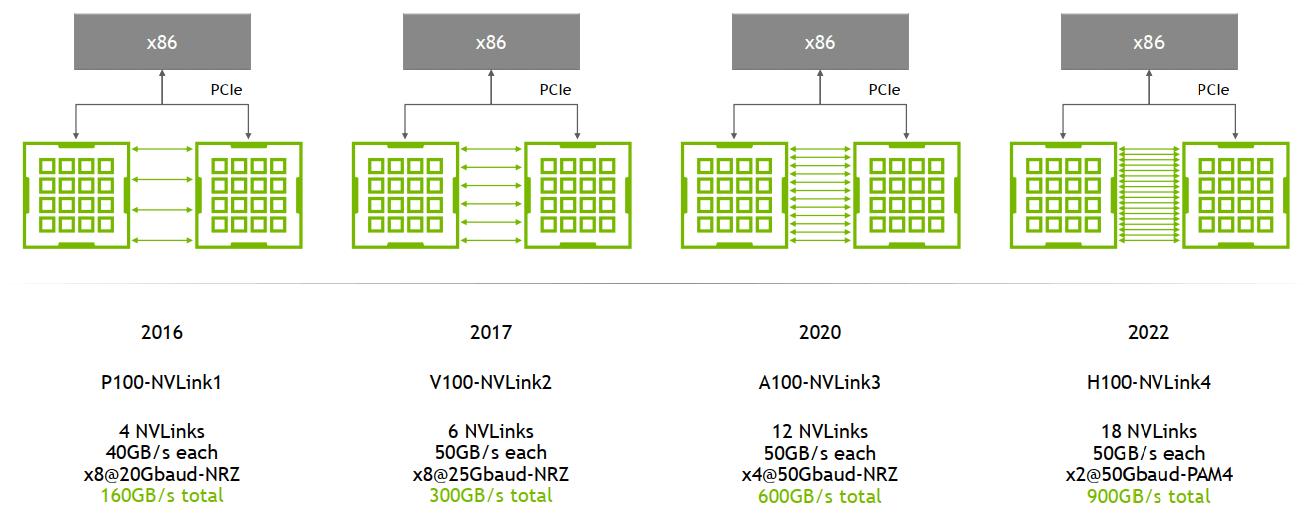

再設計出跟 NVLink 一樣好的 晶片跟晶片 互連技術 (很少公司做到這點) ;

再與鴻海這樣的代工廠打好關係、做出 DGX 等級的伺服器;

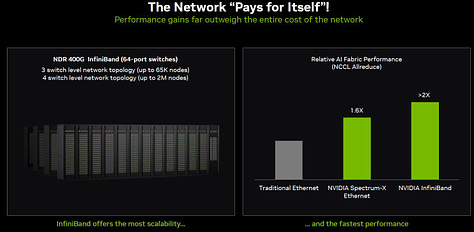

再做出與 Mellanox 一樣好的互連技術 (InfiniBand) (不只是CPU連GPU、GPU連GPU、Superchip 連 Superchip,還有機架連機架、伺服器連伺服器、資料中心連資料中心) ;

說服企業客戶使用產品 (要嘛更好、要嘛更便宜,最好兩者兼備,比 NVDA 好上十倍才有辦法說服 CIO,CIO 才能跟董事會跟股東負責);

跟 TSMC 要到 2.5D CoWoS 產能;

花錢跟時間做出跟 CUDA 一樣好的軟體 、說服全球開發人員 使用新軟體;

NVDA 不會在原地等你,需要以光速完成上述步驟;(NVDA 每 6 個月推出新產品,所以競爭對手至少要 5 個月就推出新產品)

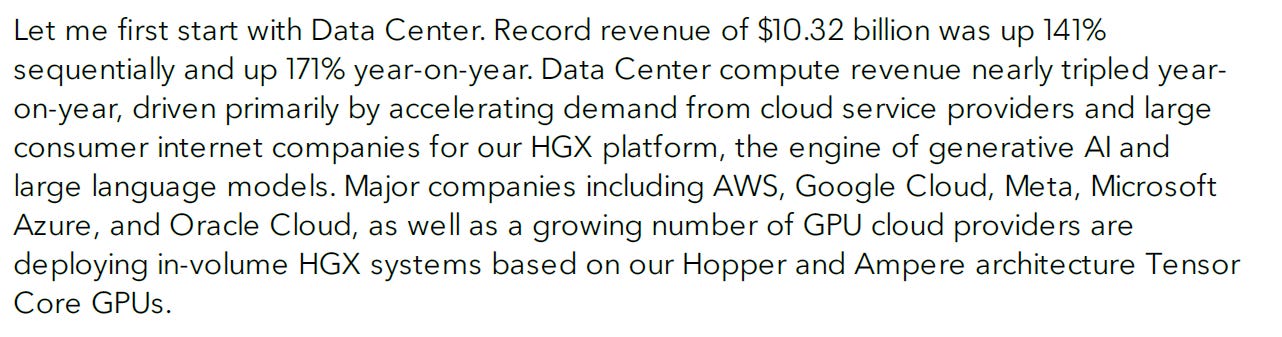

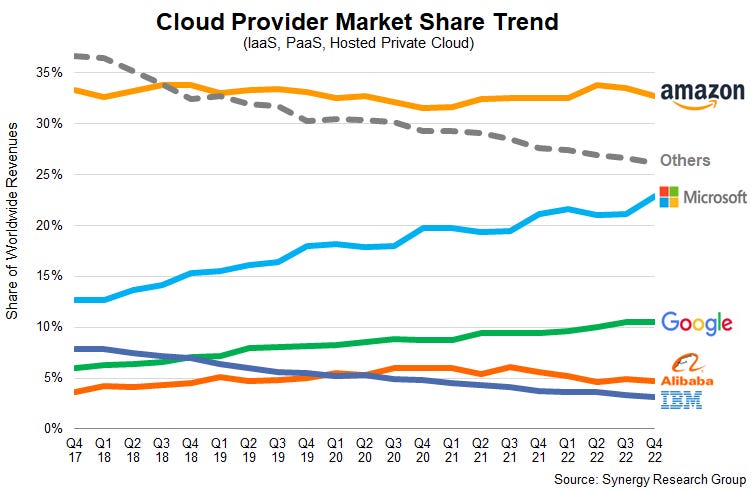

【看圖說故事】FY24Q2 的資料中心的營收中,有 50% 是來自於這些 CSPs,約 50 億美元;所謂的 CSPs 是 雲端服務供應商,大型的 CSPs 簡單說就是 Microsoft Google Amazon (Meta 也買很多伺服器),這些龍頭企業,理論上聚集了全球最聰明與最有錢的一群人,為什麼他們都搶著買 NVDA 的產品?因為買越多、省越多。

資料中心的營收年增 171% 至 103.2 億美元,主要客戶包含

雲端供應商(CSP) :AWS, Google Cloud, Meta, MSFT 的 Azure, 和 ORCL 的 OCI 等大型雲端供應商大量採用 Tensor GPU 的 HGX 平台;

大型消費者網站:主要用 #AI 來推薦商品,提供用戶想要看的東西。

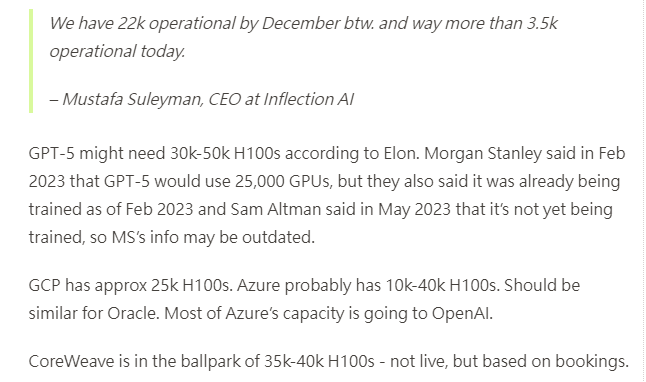

其他 GPU 雲端服務商,如 CoreWeave 等AI 新創

【看圖說故事】客戶為什麼要選擇 NVDA?因為投資報酬率!GPU是CP 值最高的產品!買越多、省越多!加速運算能用更少的資源做更多的事情!也就是說,成本變少,獲利會變高,股東就滿意,公司越大、股東越多 (尤其是那些大型 CSPs)。

通用計算太耗能、太貴、也太慢; 加速運算和生成式 AI 才是資料中心的未來,用 GPU 取代 CPU,加速計算可省錢和省電,生成式 AI 可提高生產力,並為客戶提供新服務,這才是產業需要的!

即將看到很多新的 GPU 雲端服務,如 CoreWeave 等新創會越來越多,因利用資本的最佳方法是將其投入到加速運算和生成式 AI ;

LLMs 將讓使用案例更加普及:訓練模型需要大量數據、時間與資本,只有 AI 獨角獸與大型企業才有能力提供預訓練模型 (pre-trained foundation model) - LLMs ;一般企業拿到LLMs 後,再用自有數據去微調 (fine tune) 、推論,並崁入自己的應用軟體中,AI 將越來越普及。

應用軟體生態系:民主化的最終目標是每間企業都有自己的 AI 軟體,可隨身攜帶,但不知道自己正與 $NVDA 合作;

$NVDA 與 VMware 合作,由 VMware 向企業客戶提供一個平台,客戶使用預訓練模型來構建 AI 應用程序,而無需企業構建和管理基礎架構,$NVDA 的技術將透過 VMware 帶給他們所有的客戶,這是由 NVIDIA 平台所支持的應用軟體生態系。

VMware 不僅支持 CPU的虛擬化,還支持 GPU的虛擬化,以及 GPU 的分布式計算能力,支持 NVDA 的 BlueField 高性能網路!

數以百萬計的 VMware 客戶將開始使用 VMware Private AI Foundation,並搭載 L40S 的新伺服器組合 ( HPE、Dell 和聯想),任何企業都可以擁有一個最先進的 AI 資料中心和使用生成式 AI ;

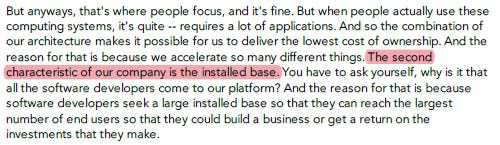

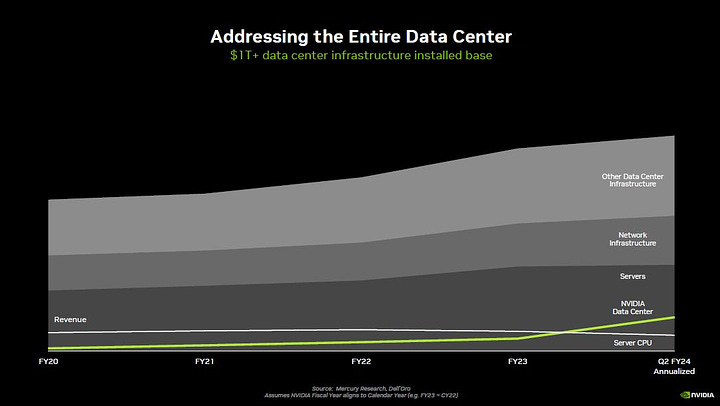

【看圖說故事】舊資料中心市場將慢慢升級新型資料中心,企業會因 CP 值而選用 GPU !資料中心的建置與更新不會這麼容易,整個升級的過程會耗費很多年, NVDA 的生意也可以做很多年。

既有資料中心的規模:已達到 1 兆美元。

同時看到兩個平台轉換的趨勢:

加速運算:最具成本效益的,最節能、最高效,帶動生成式 AI 的出現;

ChatGPT 的出現:讓每個人都知道生成式 AI !

因此,既有的資料中心都會轉型為加速運算與生成式 AI。

為什麼改建傳統資料中心很困難?

因為基礎架構不一樣,空間與散熱的需求都不一樣!聽聽專家怎麼說。

【看圖說故事】分析師擔心 NVDA 沒辦法在推論市場佔有一席之地,但是 CEO 用 蒸餾過程 (distillation) 來形容訓練的厲害,訓練與推論從這個角度上來看並非競爭關係;數據一直產生,就會一直訓練,推論竟然也會從訓練中出現!

從 LLMs 中衍生出更多的小型版本,有師生般的關係;

LLMs 擁有通用性、泛化性和 零射擊能力 (zero-shotcapability,不需標記下,模型就能夠學習和執行新任務)

突然之間,沒有訓練過的問題或技能,LLMs 就突然懂了

這就是神奇的地方!

除了

突然懂了這麼神奇的事情會發生之外,訓練與推論其實還是相輔相成的;不只如此,訓練也不是一次就結束了,因為數據會一直產生,就會需要新的訓練與微調,因此不用擔心企業做完訓練,GPU 就沒用了;

更厲害的是,NVDA 的系統是可以執行訓練與推論的,他也具備提供專門用於推理的特定系統的能力,目前推理平台的每個步驟的成本都會被納入考量,成本是 NVDA 最在行的,因此 NVDA 順利成章也將成為推理的推動者。

更進一步而言,推理也會隨著時間的推移變得極其複雜,GPU 非常適合幫助解決這個問題,所有大企業因此都會選用 NVDA 的產品,NVDA可以做的生意 (市場規模) 也會越來越大。

可以看看這些管理階層怎麼說:

【看圖說故事】策略可以分為產品策略跟商業策略; NVDA 每 6 個月就可以推出新產品,這項優勢也可以從對美中關係的應對中觀察出來;不僅僅第一次制裁 NVDA很快就推出 A800 + H800 給中國客戶,第二次制裁也很快地推出 L40S (了解美國到底在制裁甚麼:第一次制裁,第二次制裁),是 NVDA 應變能力很快的證明。

針對美中貿易戰,NVDA 的評論是:

NVDA 的資料中心營收中,有 20 - 25% 來自於中國;

目前美國政府的限制已經逐漸發揮成效,但是因為全球對 NVDA 產品的高需求,就算新限制上路,對 NVDA 的財務影響不會產生直接重大的影響。

但是,從長遠來看,美國工業將失去一個全球最大市場的機會;

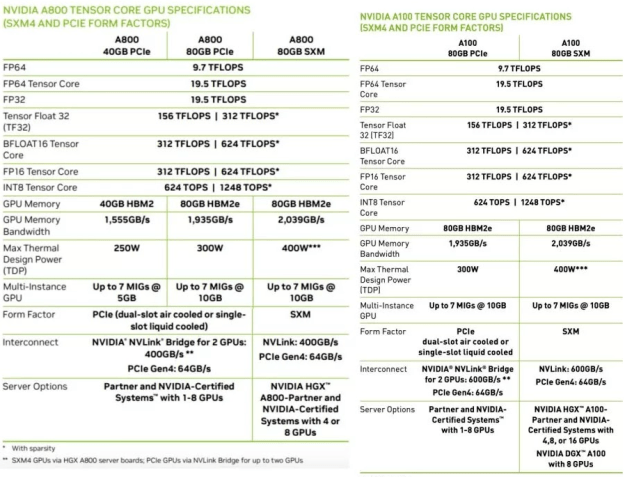

從下圖可以看到,A100 跟 A800 的主要差別在於資料傳輸速率 (Interconnect,也就是後面會提到的 NVLink 互連技術),因為美國禁令規定晶片傳輸速率高於 600GB/秒以上,就不能出口中國, A800 資料傳輸速率為 400GB/秒,較 A100 的 600GB/秒低,剛剛好符合美國禁令。

【看圖說故事】H100 的供應短缺,主要是因 CoWoS 產能不足的關係,連帶很多相關伺服器廠商沒辦法出貨,台股供應鏈的營收還沒有看到很明顯的成長,針對解決供應短缺的問題,NVDA 可以找來更多的供應商、加強與既有供應商的關係,或者是多付點錢讓他們提供產能,而求人不如求己,想辦法弄出來一個不會受到外在環境限制的產品 - L40S。

CoWoS (將記憶體跟晶片結合在一起)封裝等關鍵製程,NVDA 找到額外的、合格的產能跟供應商,預期 2024 年的每個季度的供應量都會增加。

除此之外,他們持續跟供應收合作,希望透過提供長期購買承諾與預付款,能夠讓供應商快速提供產能或快速提高供應,以滿足市場需求。

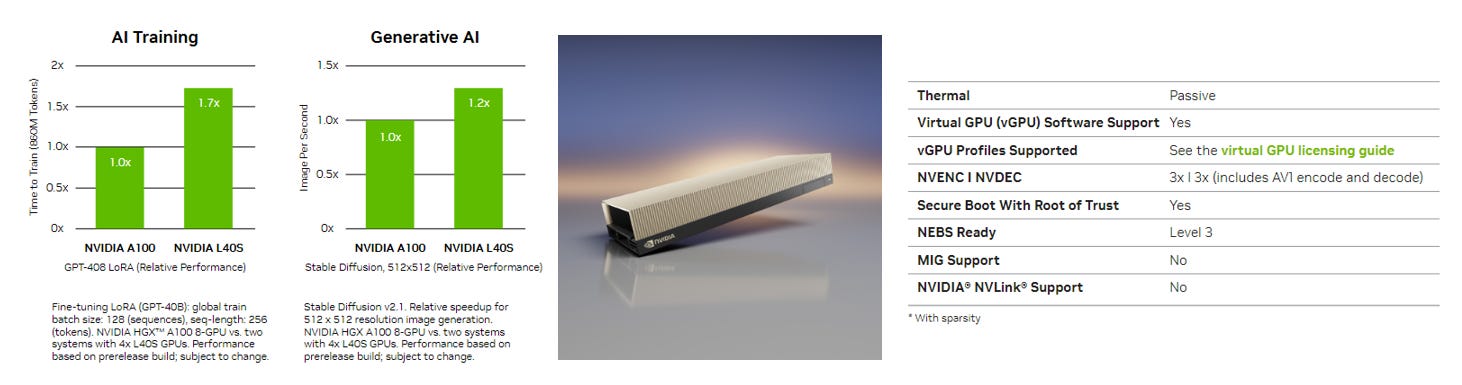

【看圖說故事】搭載全新 L40S 的伺服器,將搭配全新的軟體 - NVIDIA AI Enterprise-Ready,方便企業客戶使用,更方便廠商銷售!

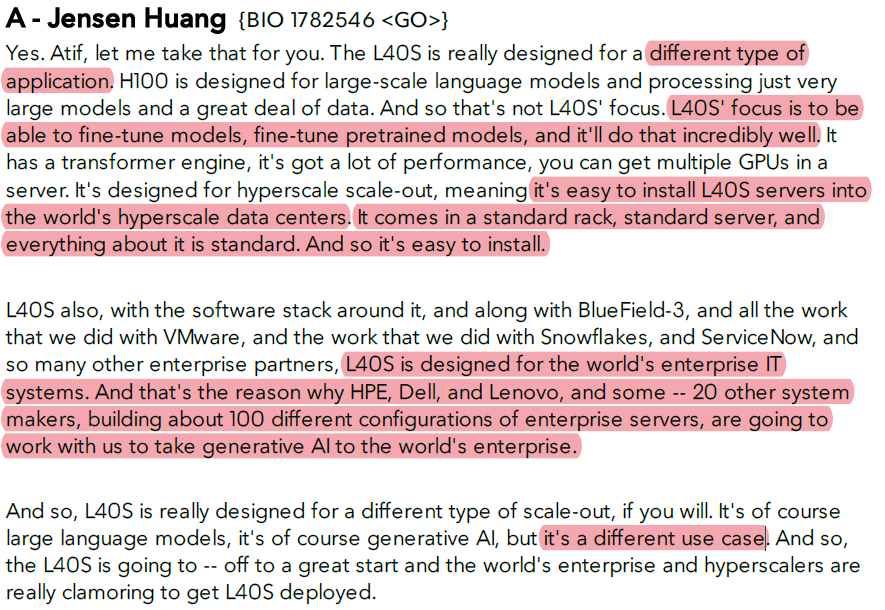

L40S 不受 CoWoS 的限制,而且已經開始出貨 (is shipping to) 給主要的伺服器系統製造商,Dell、HPE 和 Lenovo 都將開始推出搭載 NVIDIA AI Enterprise-Ready 軟體的伺服器。( 軟體部分會再提 NVIDIA AI Enterprise、NVIDIA AI Foundation )

L40S 仍適用於 LLMs 和生成式 AI,但為不同應用所設計;

具 Transformer Engine,能夠微調和預訓練模型( fine-tune models, fine-tune pretrained models)

預算更緊、又希望訓練和部署 AI 的客戶而言,L40S 是個有競爭力的選擇。

採用標準化機架,一切都是標準化,容易安裝到全球超大規模資料中心。

包含軟體,可用於全球企業 IT 系統,HPE、Dell、Lenovo 等 20 多家製造商將推出 100 種不同配置,將生成式 AI 推向全球企業

值得注意的是,L40S 並不能使用 NVLink,這有甚麼差別呢?下面會聊到。

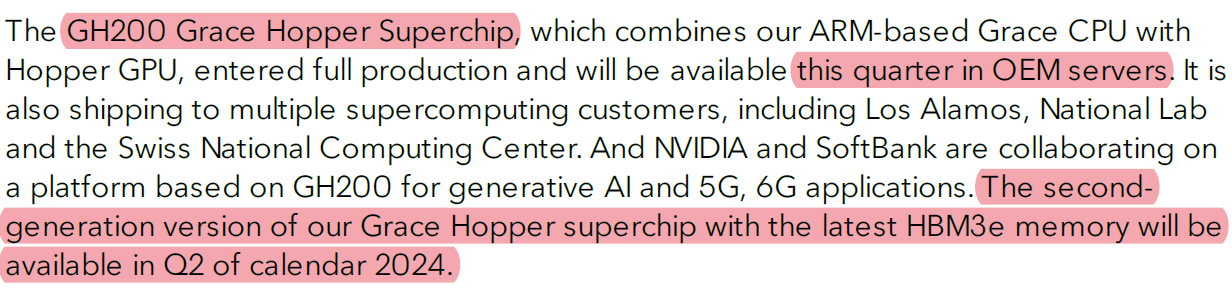

【看圖說故事】每六個月就有新產品,一直推出新產品,誰追得上?第二代超級晶片預計將在 2024 年第二季上市!

新產品:

GH200 Grace Hopper Superchip 開始生產,OEMs 伺服器本季將開始上市;

第二代超級晶片 - GH200 Grace Hopper Superchip 將配備最新的 #HBM3e ,也預計將在 2024 年第二季上市。

這是很有意思的影片,可增加對 GH200 Grace Hopper Superchip 的理解:

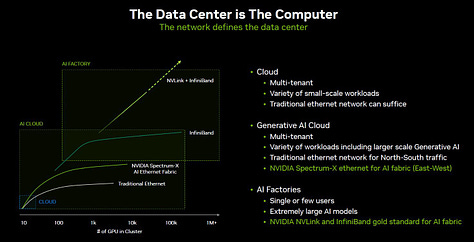

【看圖說故事】過往 CPU 都是單兵操作,靠的都是所謂的核心多寡來增加運算的能力;但到了加速運算,打的是”並聯團體戰”,各顆 GPU 雖然都很強,但彼此運算出來的結果還是要整合起來;

如果稍微注意一下,目前看到的多數網路文章在測試 AMD 新產品時,通常僅測試單一顆 GPU,尚在規劃測試兩顆以上的 AMD GPU;這篇文章 也沒有揭露測試細節,把它當作企業行銷文即可。(不過如果真有 5000 個客戶在排隊,也是挺好的)

如果沒有完善整合互聯的功能,就算單核可能可以贏過 NVDA GPU,但 2 顆以上可能就贏不過!除非他一顆可以拚過 256 顆的 GPU (GH200 Grace Hopper Superchip)

NVDA 可以比 AMD 強的原因之一就是互連技術 - NVLink、NVSwitch、NVLink switch 系統與 InfiniBand (ConnectX)

前一代只有 8 顆 Grace Hopper 超級晶片,新一代的 DGX GH200 利用 NVLink switch 系統連接 256顆的 GraceHopper 超級晶片!

NVLink switch 系統,讓 256 顆超級晶片運作起來跟一顆晶片沒兩樣!

DGX GH200 2023 年年底前就會上市,Google Cloud, Meta, 和 Microsoft 將是第一批採用的企業。

另外,只有 InfiniBand 可以擴展到數十萬顆的 GPU (In addition, only InfiniBand can scale to hundreds of thousands of GPUs)

甚麼是 NVLink 和 InfiniBand ?

【看圖說故事】如果要講到 AMD 的優勢,AMD 可以見縫插針的地方在其產品可能比較便宜 (先不談省錢是不是真的省時間 - CP值 ),提高預算低的客戶的接受度,或者是面對一些比較保守、不想大費周章改造資料中心的客戶。

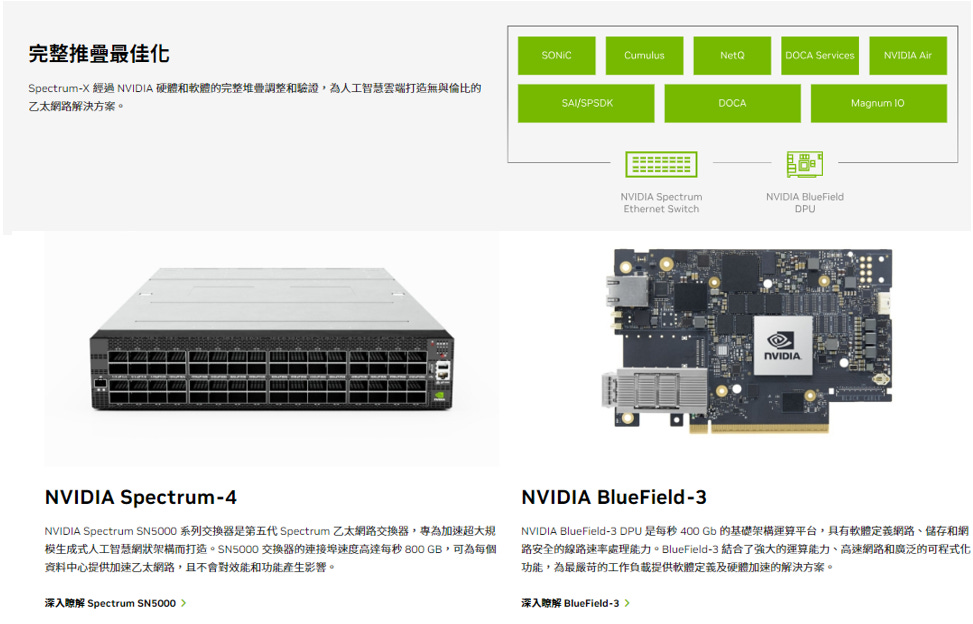

但是, NVDA 也針對不想變更資料中心的既有結構的客戶推出新產品 - Spectrum_X。

沒有 InfiniBand 、但是想要優化 AI?Spectrum_X 能滿足客戶的需求。

Spectrum_X 使用 Spectrum-4 Ethernet switch 和 BlueField 3 DPU,比傳統的乙太網路好上 1.5 倍,直接把乙太網路升級就好。

【看圖說故事】在開始講軟體之前,先來講一下另一個主題 - 囤貨。有一個陰謀論是說,NVDA 或其他人故意讓 H100 缺貨,好讓價格飆漲、賺價差。其他人會不會囤貨?不清楚;但邏輯上,站在 NVDA 的立場,當然是出貨越多越好,為什麼?

因為,在 ChatGPT 問世之前,黃仁勳在多少次 GTC 大會上用力推崇加速運算,實際影響其實都不大,很難說服企業用戶真的把以 CPU 為主的傳統資料中心改造成以 GPU 為主的 AI資料中心,為什麼?

因為兩者的基礎架構是不一樣的,企業在規劃資料中心的時候,是以 5 年為一個單位在做規劃,蓋資料中心是很複雜的,要蓋一段時間的,是長期投資的,因此不會想要輕易更動資料中心的基礎架構,這是個大工程;

然而,看到 LLMs 的威力後,企業開始想要升級資料中心,NVDA 當然想要趁機多出點貨,增加更多的市場,因為現在搶下來的市場,至少可以再賺五年,同樣也是因為只要現在資料中心的基礎架構改變了,未來五年企業都不會隨意變更架構。

【看圖說故事】大家都知道,NVDA 將顯示卡賣給玩家,把 AI GPU 賣給資料中心,但是,光靠賣硬體,可以讓毛利率超過 70%?

除了使用上述的連網裝置來提升效能、可以強迫客戶一起買之外,實際上,NVDA 還搭售毛利率更高的相關軟體,光是這次法說就提到 32 次軟體搭售。

In part of our opening that we made as well, remember, #software is a part of almost all of our products, whether they are data center products, GPU systems, or any of our products within gaming and our future automotive products

甚麼是 NVIDIA AI FOUNDATION 跟 NVIDIA AI Enterprise?

【看圖說故事】自從 2006 年推出 CUDA 之後,NVDA 實際上是披著羊皮(硬體)的狼(軟體),他不僅可以靠著硬體來佔領訓練跟推論市場,同時也靠軟體來穩定在訓練跟推論市場的地位。

為甚麼 NVDA 說自己其實是軟體公司,舉例來說,NVDA 也推出軟體 (函式庫) 來強化硬體 (H100) 的推論能力,試問有多少企業能像他這樣軟體通吃?

【看圖說故事】企業希望訪問這些大型語言模型,並且希望使用自己的數據對其進行自定義,而不會將其專有數據洩露到通用模型,但不是每個企業都有資本或能力去自行建構 AI 資料中心;

所以,NVDA 推出 GPU 雲端 ( NVDA 自有 DGX Cloud ,以及 CSPs DGX Cloud),也讓更多的 CSPs 用戶接觸到 NVDA 的軟體與技術支援。

從一些小細節就可以看出來,NVDA 自己推出 DGX Cloud,但同時也把這個硬體 (DGX Cloud) 放在其他主要 CSPs 的雲端上,讓他們賣給客戶;那這樣兩者有甚麼差別?

有的,從技術架構圖來看,雲端業者負責雲端服務的支援,NVDA 提供 AI 技術客服窗口和 AI 專家的技術支援服務

也就是說,CSPs 只負責販售,其他的技術支援都由 NVDA 自己負責;

更扯的是,自有 DGX Cloud 上才有 NVDA AI Enterprise ( 內含 4500 個軟體套件) 這些方便的工具;

但是為了避免 CSPs 抗議,他又把自有 DGX Cloud 的價錢弄得很貴 (畢竟有NVDA AI Enterprise 等工具),以做出市場區隔。

GOOGLE、AMZN 跟 MSFT 都跟 NVDA 合作:

【看圖說故事】不管 DGX Cloud 或是 HGX Cloud,都能夠讓買不起 GPU 的客戶趕快接觸到所需要的運力,AI 新創更需要這樣的幫助。

NVDA (以及多數的科技巨頭)可以透過投資跟雲端租賃的方式盡早接觸到新創;最會用這招的應該是 Amazon,透過 AWS 可以接觸到需要雲端服務的新創,以按需付費的模式,協助新創在未找到正確的商業模式之前,先盡量減少硬體支出,規模壯大之後,AWS 在提供升級的軟硬體服務來留住客戶;不僅可以增加自己的收入,還可以致敬或併購對方,擴大自己的規模;就靠這招,當雲端霸主當了十多年。

投資之前,可以了解這些新創的潛力;投資之後,這些投入資金會被拿來買 H100 或是租雲端,因為所有新創 (以及多數的科技巨頭)都希望盡快推出 MVP 來搶佔市場,也就回到買越多省越多的假設;

接著,這些新創推出 AI 服務讓更多消費者接觸到 AI,市場認同度越高, AI 市場也就越大,也會讓 GPU 雲端的用量越大,按使用量付費的情況下,這些錢有一部分也會回到 NVDA;

最好的情況下,AI 市場被擴大,NVDA 的市占便更大,如果 新創上市,還可以讓 NVDA 的股權變現金。

【看圖說故事】最近可以看到滿多投資新創的新聞,爭議比較大的可能是 CoreWeave ,主要是因為有篇文章指責該公司與 NVDA 聯手作假帳 (讀完原文覺得有點浪費時間,所以就不提供連結了);拿 H100 去抵押融資,雖然可以證明 H100 本身的價值,但不可否認的槓桿化 (借錢買更多 H100) 讓社會觀感不佳;

但是,要說假帳也太超過,畢竟 NVDA 要跟所有 CSPs 套好招,向全世界宣布買不到 H100 是不合邏輯的,這些人可是全世界最有錢、最聰明的一群人;更何況,讓更多資料中心都升級為加速運算,長期來說對 NVDA 最有利。

Bernstein 駁斥有關 $NVDA 做假帳的傳言:

CoreWeave 優勢在於只專注於 GPU,因為傳統雲端的基礎設計本來就不是用來處理加速運算的,如果要符合 AI 需求,整個資料中心的架構都要重新調整,調整不僅花錢,還要耗時間。

【看圖說故事】根據 Nvidia: The Dawn of the AI Era ,2006 年推出 CUDA 之後,開發人員在 4 年之後達到 10 萬人的水準;2016 年突破 100 萬名開發者;2018 年,全球開發者倍增至 200 萬人,2022 年有 300 萬人,2023 年 5月全球已有 400 萬註冊開發者。

做一個奇怪的比較,根據彭博資料,NVDA 有 2.6 萬名員工,AMZN 有 146 萬 (可能多數是倉儲員工),META有 7.1 萬,MSFT 有 22.1 萬,GOOGLE 有 18.1 萬。

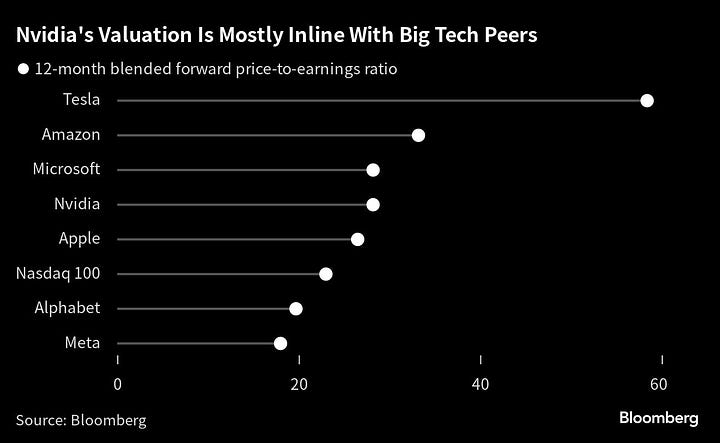

【看圖說故事】跟 5 月比,NVDA 變便宜還變貴?FY24Q1 後 BF P/E ratio (Forward) 為 51.6x,Q2 後剩 30.0X,低於歷史平均 39.4X,標準差從 +1 掉到 -1 基本面變差?分析師估營收估成長,但大家都變便宜, 升息?

MS 看好 NVDA 下跌帶來買進機會:對 AI 晶片需求可持續性的擔憂,很快會被其管理評論或業績打消 升息影響其股價遠低於目標價,跟其他巨頭相比,其估值不貴,Forward PER 僅 28x (10年平均 32x),Grizzle 分析師認為,未來幾年回頭看,會覺得現在很便宜。

分析師評論:

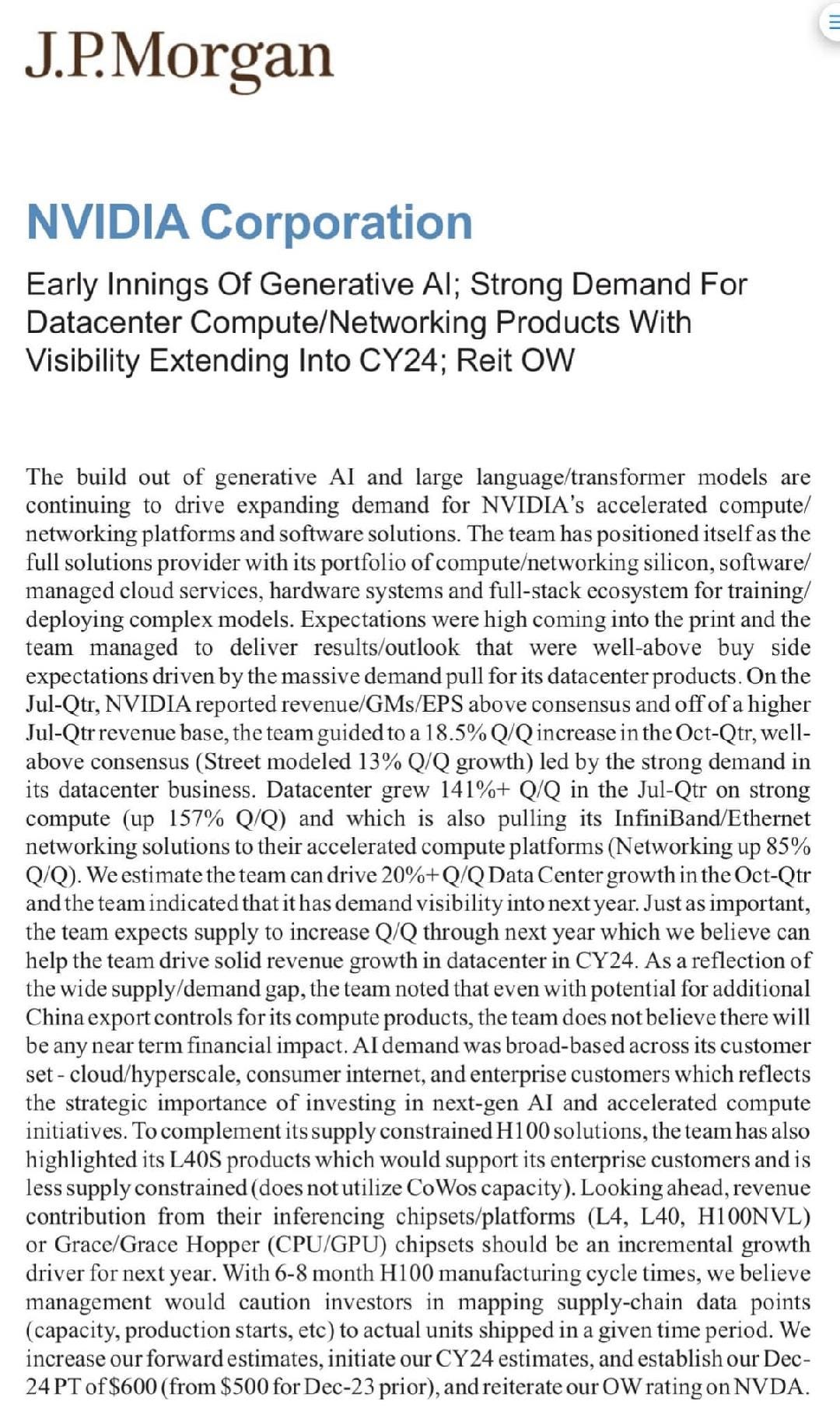

$JPM 認為:

生成式 #AI 與 #LLMs 持續帶動 NVDA 的 資料中心的營收表現,季增 141%

運算 (Computing):季增 157%

網路 (InfiniBand/Ethernet):季增 85%

NVDA 將自己定位為針對 訓練 + 推論 的 #全方位解決方案 的供應商,其解決方案包含:運算/網路晶片、軟體與雲端管理服務、硬體系統、全端生態系

有幾個因素可以確認營收維持成長:

訂單能見度已到明年底

供應將持續維持季增趨勢到明年底

因供給與需求間龐大的落差,NVDA 預期就算針對中國的出口禁令開始實施,對 財務的短期影響也不大。

AI 的需求是全面性的,涵蓋雲端、超大規模資料中心、消費性網站與企業客戶。

為了解決因為 WoCoS 產能問題所造成的 H100 短缺問題,推出 L40S 來滿足企業用戶的需求。

預估明年成長有機會向上提升,因為:

推論晶片:L4+L40+H100NVL

超級晶片:Grace 和 Grace Hopper